Ứng dụng AI vào công việc là sai lầm lớn nhất của tôi!

Một người đàn ông tên Roberto Mata vừa đâm đơn kiện hãng hàng không Avianca do bị xe đẩy hàng tại sân bay quốc tế Kennedy, New York tông phải. Khi Avianca yêu cầu thẩm phán liên bang ở Manhattan hủy bỏ vụ kiện, luật sư của ông Mata đã phản đối kịch liệt, sau đó đệ trình một bản tóm tắt dài 10 trang trích dẫn các vụ kiện có liên quan, chẳng hạn như một người đàn ông tên Martinez kiện hãng Delta Air Lines, Zicherman kiện Korean Air Lines và Varghese kiện China Southern Airlines.

Tuy nhiên sau đó, không một ai, kể cả luật sư hãng hàng không và chính thẩm phán, có thể tìm được nguồn trích dẫn cho những thông tin trên. Hóa ra, mọi tài liệu tóm tắt đều được ChatGPT tạo ra.

Vị luật sư tham khảo nguồn chatbot, Steven A. Schwartz của công ty luật Levidow, Levidow & Oberman, đã xin tòa tha thứ. Ông cho biết mình đã sai khi sử dụng chương trình trí tuệ nhân tạo không đáng tin để dẫn chứng cho vụ kiện.

Theo The New York Times, ông Schwartz đã hành nghề luật sư ở New York trong 30 năm và không hề có ý định lừa dối tòa. Ông cho biết mình chưa bao giờ sử dụng ChatGPT, “do đó không biết rằng nó có thể sai” và xin hứa sẽ không bao giờ làm như vậy nữa.

Thẩm phán Castel cho biết bản thân ông chưa bao giờ phải đối mặt với bản đệ trình pháp lý chứa đầy “các phán quyết không có thật” như vậy. Ông đã quyết định tổ chức một phiên tòa vào ngày 8/6 để thảo luận phương án trừng phạt vị luật sư trên.

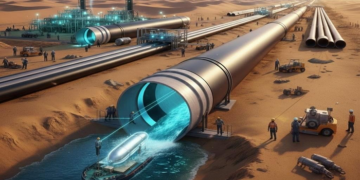

Khi AI càn quét thế giới trực tuyến, nó đã gợi ra viễn cảnh rằng một ngày nào đó, máy móc sẽ thay thế con người làm việc. Nỗi sợ đặc biệt lớn đối với những lao động tri thức.

Theo Stephen Gillers, giáo sư đạo đức pháp lý tại Trường Luật Đại học New York, vấn đề này đặc biệt gay gắt giữa các luật sư – những người vốn đang tranh luận về giá trị cũng như sự nguy hiểm của AI.

“Bạn không thể dùng ChatGPT, lấy thông tin rồi dán nó vào hồ sơ tòa án của mình”, ông Stephen Gillers nói.

Trước đó, các luật sư của hãng hàng không Avianca đã viết thư cho Thẩm phán Castel, nói rằng họ không thể tìm thấy các trường hợp được trích dẫn trong bản tóm tắt của luật sư Roberto Mata.

“Không thể tìm thấy câu trích dẫn này, cũng như bất cứ thứ gì tương tự như vậy”, luật sư hãng hàng không nói.

Bart Banino, luật sư của Avianca, nói rằng công ty của ông là Condon & Forsyth cũng không thể tìm ra bằng chứng cho thấy các dẫn chứng là thật. Ông nghi ngờ rằng một chatbot có thể đã ‘nhúng tay’.

Được biết ChatGPT đã vướng vào rất nhiều tranh cãi, chẳng hạn như phải mất bao lâu, công nghệ này mới có thể hoạt động mà không cần bất kỳ sự can thiệp nào của con người. Chính CEO Sam Altman của Open AI cũng thừa nhận hạn chế của công nghệ này.

“ChatGPT vẫn còn nhiều thiếu sót nhưng lại khiến mọi người cho rằng nó hoàn hảo. Chúng ta không nên phụ thuộc vào chatbot này đối với những vấn đề quan trọng”, ông chia sẻ.

Trước đó, đồng sáng lập Apple Steve Wozniak, Elon Musk cùng hơn 1.000 nhà lãnh đạo doanh nghiệp vừa ký một bức thư yêu cầu các biện pháp bảo mật và tạm dừng phát triển các mô hình AI trong bối cảnh công nghệ trí tuệ nhân tạo bùng nổ. Họ lập luận rằng các mô hình AI mạnh mẽ như GPT-4 của OpenAI chỉ nên phát triển nếu dành được sự tin tưởng và kiểm soát được toàn bộ rủi ro.

“Đó là một ý tưởng rất hay để làm chậm quá trình phát triển mô hình mới bởi vì nếu AI thực sự tốt, việc chờ đợi hàng tháng hoặc hàng năm cũng chẳng có hại gì, dù sao chúng ta cũng sẽ đi đến đích”, James Grimmelmann, giáo sư về kỹ thuật số cho biết.

Theo: The New York Times-Vũ Anh-Theo Nhịp sống thị trường